Bagaimana polisi Kerala memanfaatkan kecerdasan buatan (AI) untuk menangkap para pedofil di dark web. Dan ini merupakan yang pertama di India

Liga335 – “CHEEZE PIZZA”, demikian tertulis nama forum terenkripsi tersebut. Pada suatu saat di tahun 2025, tim Penanggulangan Eksploitasi Seksual Anak (CCSE) Kepolisian Kerala menemukan forum tersebut secara tak sengaja saat melakukan patroli siber rutin di dark web. Forum tersebut merupakan salah satu tempat di mana banyak orang bertukar tautan ke materi pelecehan seksual anak (CSAM) dan mengarahkan orang lain ke grup Telegram pribadi tempat konten tersebut dapat dibeli dan diakses.

Baca Selengkapnya

Saat menyelidiki “CHEEZE PIZZA”, para penyidik menemukan gambar seorang anak yang “mirip orang Kerala”. Pengguna tersebut telah memposting banyak foto dan video anak yang sama. Hal ini membuat polisi menyelidiki lebih dalam.

Berbulan-bulan pelacakan digital pun dilakukan. Polisi menjalin pertemanan dengan tersangka secara daring dan memperoleh akses ke kredensial Facebook dan Instagram. Jejak tersebut membawa mereka ke seorang wanita di Bengaluru, namun lokasi akun tersebut menunjukkan Thiruvananthapuram.

Petunjuk tersebut berasal dari daftar teman Facebook wanita tersebut. Salah satu teman Facebook-nya berasal dari Thiruvananthapuram.

Polisi melacak profil tersebut dan kemudian memeriksa tampilan Foto-foto yang dimiliki orang tersebut di grup-grup Telegram yang digunakan untuk penyebaran CSAM.

Sebuah rumah yang terlihat dalam salah satu gambar cocok dengan lokasi di Thiruvananthapuram yang telah mereka identifikasi. Ketika petugas memeriksa rumah tersebut, mereka menemukan anak itu. Ia adalah keponakan tersangka.

Anak itu diselamatkan dan diberi konseling. Pelaku ditangkap dan diproses hukum.

Meskipun salah satu bagian dari kisah ini adalah ketekunan petugas Kepolisian Kerala, terobosan ini dimungkinkan berkat alat kecerdasan buatan (AI).

Alat tersebut mengolah volume data yang sangat besar yang tersebar di berbagai platform untuk menyempitkan pencarian hingga menemukan pelaku. Tanpa alat tersebut, menganalisis data secara manual akan memakan waktu jauh lebih lama.

Untuk menangani lonjakan kasus pelecehan seksual anak secara daring, Pusat Penanggulangan Eksploitasi Seksual Anak Kepolisian Kerala, untuk pertama kalinya di India, mengintegrasikan AI dalam penyelidikannya.

Ini adalah platform penyelidikan berbasis AI bernama Katalyst, yang saat ini sedang diuji coba. Kini, Kepolisian Kerala sedang berupaya mengintegrasikan g versi terbaru dari alat yang dikembangkan oleh Kindred Tech yang berbasis di Selandia Baru dan didukung oleh infrastruktur data MongoDB.

“Dengan tim yang kecil, Anda tidak mungkin memeriksa semuanya secara manual,” kata Ankit Asokan, Kepala Satuan Tindak Pidana Siber Kepolisian Kerala, menjelaskan mengapa Katalyst sangat penting dalam menangani volume besar bukti digital.

“Masalah ini diperparah oleh perkembangan teknologi. Kita harus menggunakan teknologi untuk melawan,” tambahnya. Meskipun tumpukan bukti digital merupakan tantangan, tantangan lain dalam kasus CSAM adalah “tidak ada korban yang datang kepada kami,” kata SP Asokan.

Katalyst telah memberikan keunggulan teknologi yang sangat dibutuhkan Kepolisian Kerala untuk membantu mengidentifikasi korban dan menghentikan pelecehan terhadap anak-anak, yang menuntut pemeriksaan terhadap sejumlah besar data dan intervensi proaktif. Selama proyek percontohan selama 18 bulan (mulai 2024) antara Kepolisian Kerala dan Kindred Tech, penyidik melaporkan 96 penangkapan. Hal ini berujung pada penyelamatan 20 anak dan 18 rujukan internasional, menurut angka resmi dari K Kindred Tech dan MongoDB.

“Misi kami adalah memberdayakan para penyidik dengan alat yang dapat mengungkap wawasan lebih cepat dan memastikan setiap kasus anak mendapatkan perhatian mendesak yang dibutuhkannya,” kata Bree Atkinson, CEO Kindred Tech yang berbasis di Auckland, kepada Digital. Atkinson menambahkan bahwa Katalyst memungkinkan petugas untuk “menghabiskan lebih sedikit waktu terjebak dalam data dan lebih banyak waktu untuk melindungi anak-anak”.

Namun, pertama-tama, mari kita mundur sejenak dan memahami apa itu CSAM, serta apa yang sebenarnya terjadi dalam kasus-kasus semacam ini?

Selain itu, kita akan melihat seberapa dalam dan berbahayanya ancaman ini, serta bagaimana integrasi AI telah memberikan keunggulan teknologi bagi Kepolisian Kerala dalam mengungkap kasus-kasus CSAM di negara bagian tersebut.

APA ITU CSAM? SEBERAPA BESAR ANCAMANNYA?

Materi pelecehan seksual anak, yang disebut CSAM, terdiri dari gambar, video, atau konten digital yang menggambarkan pelecehan atau eksploitasi seksual terhadap seorang anak.

“Dulu, kami menyebutnya pelecehan seksual anak secara daring. Sekarang cakupannya lebih luas.

Ini adalah pelecehan seksual anak yang difasilitasi oleh teknologi,” kata Ankit Asokan, SP Cyber Crime, Kepolisian Kerala, katanya kepada Digital.

“Ada seorang anak. Ada teknologi.

Dan ada berbagai cara pembuatan konten,” tambahnya.

Secara tradisional, materi pelecehan terbagi menjadi dua kategori; konten yang dipaksakan atau diperas dari anak-anak, dan pelecehan yang direkam oleh seseorang yang berada dalam posisi berkuasa atau berwenang. Kini, kategori ketiga mulai muncul.

Yaitu konten yang dihasilkan oleh AI atau dimanipulasi secara digital dengan menggunakan ciri-ciri yang dapat dikenali dari anak-anak sungguhan.

Setelah dibuat, materi tersebut menyebar dengan cepat. “Ini menjadi sebuah ekosistem,” kata Asokan, menggambarkan rantai di mana konten ditransmisikan, dijual, dikonsumsi, dan dibagikan kembali di berbagai platform.

Skala CSAM di India sangat mengejutkan. Pada tahun 2024, lembaga-lembaga India menerima 2,2 juta laporan cyber-tip terkait pelecehan seksual anak secara daring, menurut National Centre for Missing and Exploited Children (NCMEC), sebuah LSM berbasis di AS. Pada tahun 2024, Internet Watch Foundation mencatat rekor 291.

273 laporan materi pelecehan seksual anak di Uni Eropa, menurut Kementerian Pemberdayaan Perempuan dan Anak t.

“Ancaman ini bersifat global,” tegas Inspektur Asokan. Lonjakan ini terkait dengan semakin banyaknya anak-anak yang menggunakan internet, maraknya aplikasi pesan instan, platform game, serta penyebaran media sintetis yang pesat.

“Dalam kejahatan biasa, ada korban yang menuntut keadilan. Dalam kasus-kasus ini, tidak ada korban yang datang kepada kami,” kata Asokan.

Pada tahun 2021 saja, Pusat Nasional AS untuk Anak Hilang dan Dieksploitasi menerima 29,3 juta laporan yang berisi 39,9 juta gambar dan 44,8 juta video, serta memberi tahu penegak hukum mengenai lebih dari 4.

260 calon korban anak baru, menurut laporan tertulis dari ECPAT International (jaringan global yang berupaya mengakhiri eksploitasi seksual anak) kepada Kantor PBB untuk Narkoba dan Kejahatan (UNODC).

Namun, skala ini terjadi lebih dari lima tahun yang lalu, dan angka-angka tersebut kini semakin meningkat.

BAGAIMANA POLISI KERALA MEMERANGI CSAM DENGAN AI?

Tanggapan Polisi Kerala didasarkan pada kemitraan teknologi dan pelatihan khusus.

Pada tahun 2024, Pusat Penanggulangan Eksploitasi Seksual Anak (CCSE) ) memulai uji coba selama 18 bulan terhadap Katalyst, sebuah platform investigasi digital berbasis kecerdasan buatan yang dikembangkan oleh Kindred Tech, sebuah organisasi nirlaba yang mengembangkan alat bantu untuk penegak hukum.

Selama uji coba tersebut, kepolisian meluncurkan Operasi P-Hunt dan menangkap 96 orang.

Pada bulan Februari, empat orang ditangkap, dan 51 perangkat digital disita di distrik Ernakulam sebagai bagian dari Operasi P-Hunt. Polisi melakukan penggerebekan di 82 lokasi. Setidaknya 36 di antaranya berada di kota dan 46 di daerah pedesaan, demikian dilaporkan surat kabar The Hindu.

Inisiatif Kepolisian Kerala ini juga telah menerima Penghargaan Keunggulan Technology Sabha tingkat negara bagian.

Kepolisian Kerala juga telah bekerja sama dengan para ahli teknologi dari Selandia Baru melalui inisiatif Cyber Dome dan hackathon, membangun alat secara kolaboratif alih-alih mengalihdayakan penyelidikan.

“Misi kami adalah memberdayakan penyidik dan lembaga penegak hukum dengan alat yang dapat mengungkap wawasan lebih cepat dan memastikan setiap kasus anak mendapatkan perhatian mendesak yang dibutuhkannya.

MongoDB membantu kami menggabungkan data eks “Dengan memanfaatkan data menggunakan kecerdasan buatan (AI), Katalyst dapat mengungkap wawasan penting lebih cepat, sehingga penyidik di India dapat menghabiskan lebih sedikit waktu untuk menganalisis data dan lebih banyak waktu untuk melindungi anak-anak,” kata Peter Pilley, pendiri Pathfinder Labs yang berbasis di Auckland, kepada Digital.

“Kami tidak mengalihdayakan penyelidikan,” jelas Asokan, sambil menambahkan, “Mereka adalah personel kepolisian yang terlatih dalam teknologi.”

BAGAIMANA MATERIAL PELECEHAN SEKSUAL ANAK DIBUAT?

Mekanisme pelecehan seksual, terutama dalam konteks anak-anak, telah berkembang. Paksaan kini sering dimulai di obrolan game atau pesan langsung media sosial. Pelaku merayu anak-anak, meminta gambar, dan kemudian menggunakan ancaman untuk memeras lebih banyak.

Di sisi lain, alat AI dapat menghasilkan gambar hiperrealistis menggunakan potongan wajah anak yang diambil dari media sosial, jelas SP Asokan.

“Ini dikonsumsi oleh orang-orang. Ini disebarkan dan dijual oleh orang-orang.

Dan sekali lagi, orang-orang juga membuatnya secara online,” kata Asokan kepada Digital.

“Dan kemudian ada kategori seperti penyebaran gambar tanpa persetujuan ng, yang kadang-kadang disebut sebagai “revenge porn”, meskipun kami tidak menganjurkan penggunaan istilah tersebut, yaitu ketika materi atau konten diambil dari orang lain dan dibagikan oleh pihak ketiga. Salah satu kategori yang paling merugikan saat ini adalah sextortion, khususnya yang menargetkan anak laki-laki.

Dan hal itu kini terjadi di sejumlah platform,” kata Bree Atkinson, CEO Kindred Tech, kepada Digital.

Tidak seperti kejahatan konvensional, penyelidikan CSAM sebagian besar bersifat proaktif. “Semuanya berjalan di latar belakang,” kata SP Asokan.

Anak tersebut mungkin tidak tahu bahwa materi tersebut ada. Konsumen dan pembuatnya bisa jadi adalah individu yang berada di yurisdiksi yang berbeda.

“Tidak ada area di internet atau di luarnya yang bisa dibilang sebagai tempat di mana hal ini tidak terjadi.

Salah satu hal yang paling mengejutkan orang adalah keyakinan mereka bahwa hal ini terjadi di area tersembunyi, jauh dari pandangan, di tempat yang begitu spesifik dan rahasia sehingga mereka tidak akan pernah melihatnya. Namun, hal ini ada di internet. Hal ini ada di tempat yang sama dengan tempat mereka aktif saat ini,” kata Peter Pilley, yang, sebelum getti yang bergabung dengan Pathfinder Labs, telah menyelidiki kasus-kasus pelecehan seksual anak di Selandia Baru selama 15 tahun.

BAGAIMANA POLISI KERALA MENGGUNAKAN AI UNTUK MENGUNGKAP KASUS CSAM

Pemeriksaan forensik manual terhadap bukti dalam penyelidikan CSAM sering kali berarti menyisir 200–250 (atau lebih) GB data per kasus.

Perangkat yang disita, penyimpanan cloud, dan jejak digital lainnya harus disisir dengan cermat. Laporan cyber-tip (peringatan digital) mencakup 35 halaman metadata (data tentang data), log obrolan yang luas, pengenal platform, dan hash file, sehingga membuat proses investigasi manual menjadi lambat dan memakan banyak sumber daya.

Pada tahun 2024 saja, lembaga-lembaga di India menerima 2,2 juta laporan cyber-tip dari National Centre for Missing and Exploited Children, masing-masing rata-rata berisi 35 halaman bukti digital yang padat.

Di sinilah AI membantu Kepolisian Kerala menyaring kumpulan data yang sangat besar ini.

Hal ini memungkinkan petunjuk penting muncul dengan cepat dan memungkinkan penegak hukum mengidentifikasi korban dan pelaku serta melakukan intervensi lebih cepat terhadap pelecehan yang sedang berlangsung.

Katalyst mengotomatiskan proses pengambilan dan prioritasasi melalui laporan cyber-tip, menyediakan alat manajemen kasus canggih, perpustakaan media yang aman, kategorisasi media sensitif berbasis AI, serta dukungan forensik otomatis bagi kepolisian. “Katalyst menyimpan temuan AI bersama data mentah dan membantu penyidik mencari pola serupa untuk mengidentifikasi kasus pelecehan berulang,” kata Peter Pilley dari Pathfinder Labs yang berbasis di Auckland.

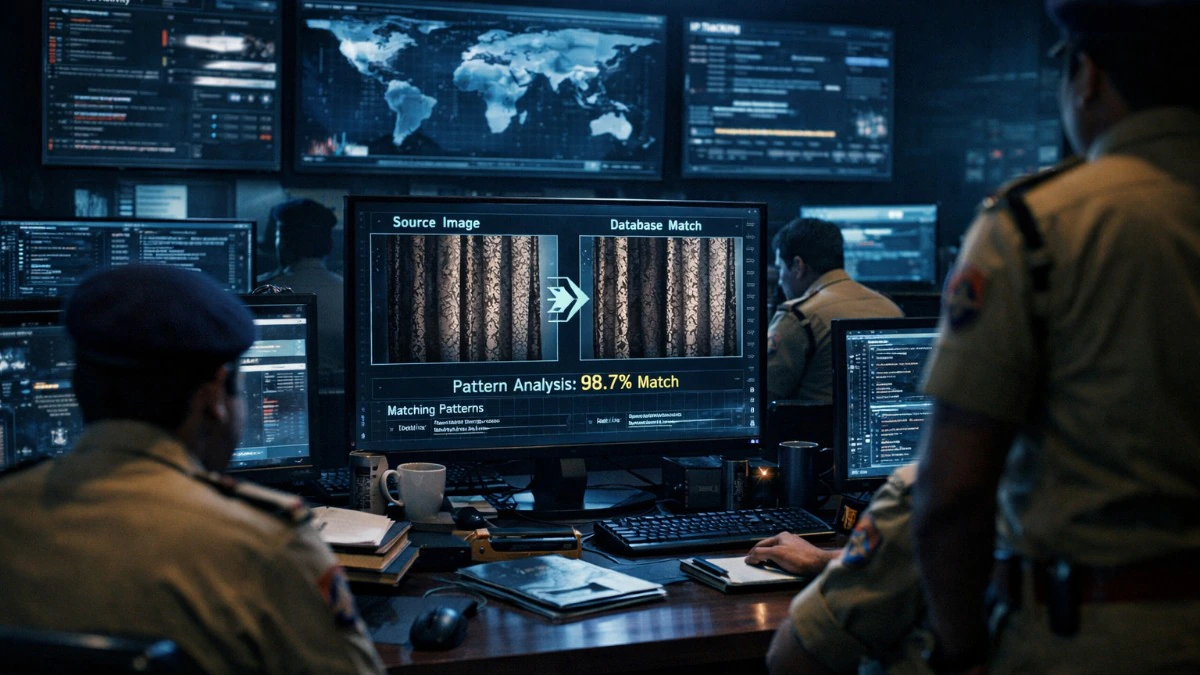

Salah satu teknik paling kuat melibatkan pelacakan objek.

Serangkaian pelecehan tunggal mungkin berlangsung selama bertahun-tahun, direkam dengan latar belakang yang sama. Di situlah platform AI seperti Katalyst dapat mengisolasi pola. Desain di dinding, lampu, warna cat dinding, atau pola pada tirai, diambil sebagai sampel dari sisa gambar.

Fragmen tersebut kemudian dapat dibagikan secara publik untuk pengumpulan informasi berbasis crowdsourcing, tanpa mengekspos konten eksplisit.

Selain itu, misalkan “seorang anak berada di bawah pengawasan seseorang dan mengalami pelecehan secara paksa. Ada tirai di ruangan yang sama, dan ada sekitar 100 video yang muncul dalam satu tahun.

Saya “Jika para penyidik menyadari bahwa itu adalah tirai yang sama, mereka bisa mencoba melacaknya. Jika Anda bisa mengetahui di mana tirai ini berada, atau siapa yang membuatnya, atau dari wilayah mana di negara ini desain atau cetakan blok tersebut berasal, maka polisi dapat menganalisis polanya,” kata Asokan kepada Digital. “Kita bisa melakukan penyaringan awal,” ujarnya.

Asokan, menggunakan contoh ini untuk menunjukkan betapa berguna Katalyst, mengatakan, “Ini jelas merupakan [alat] yang pertama dari jenisnya.”

Demikian pula, seperti dalam kasus Thiruvananthapuram, di mana pelaku mengeksploitasi keponakannya, analisis metadata media sosial dan perbandingan gambar yang dibantu AI mempersempit lokasi dan identitas tersangka.

Penggunaan Katalyst oleh Kepolisian Kerala sepenuhnya berfokus pada pemanfaatan teknologi untuk memerangi kejahatan yang dipicu oleh teknologi.

Ini juga bertujuan untuk menyelamatkan anak-anak lebih cepat dan menuntut pertanggungjawaban pelaku dalam ekosistem di mana korban seringkali tidak dapat melapor sendiri.

“Masalah ini diperparah oleh teknologi. Kita harus menggunakan teknologi untuk melawan balik,” kata Asokan, menambahkan, “Tidak ada yang akan datang dan “Jangan hanya mengeluh.

Jadi, kita harus bertindak.”