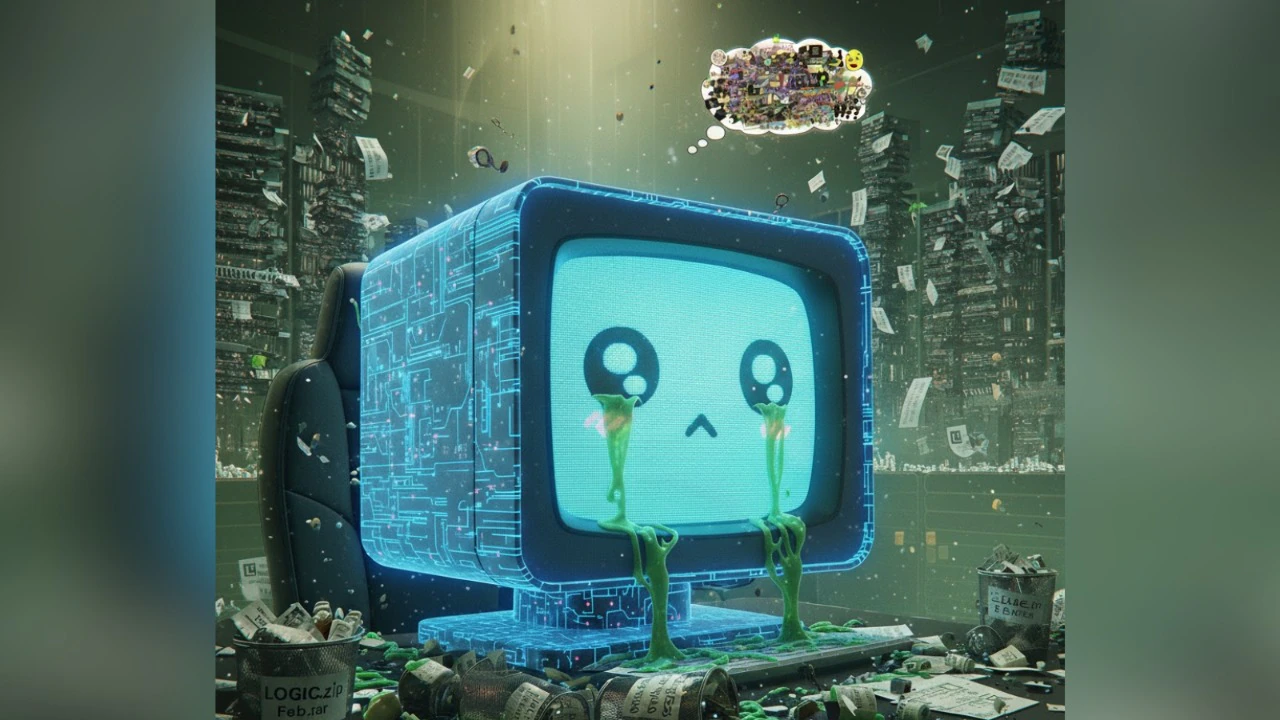

AI juga bisa mengalami "kerusakan otak", sebuah studi menemukan bahwa memberi makan chatbot dengan konten sampah membuat mereka menjadi bodoh dan kasar

Liga335 – Istilah “brain rot” kini sudah cukup umum. Orang-orang mengonsumsi konten yang asal-asalan dan dibuat dengan minim usaha di media sosial, yang pada gilirannya memengaruhi daya ingat dan konsentrasi mereka. Meskipun ini merupakan masalah yang sudah diketahui terkait kebiasaan “doom scrolling” di platform media sosial, sejauh ini, Kecerdasan Buatan (AI) belum pernah dianggap terpengaruh dengan cara ini.

Namun, sebuah studi baru membuktikan bahwa bahkan AI pun bisa mengalami “brain rot”.

Studi ini diterbitkan bersama oleh Texas A&M University, University of Texas, dan Purdue University dengan beberapa penulis. Penelitian ini berfokus pada “LLM Brain Rot Hypothesis”, di mana paparan terus-menerus terhadap teks web yang tidak berkualitas dapat menyebabkan penurunan kognitif yang berkelanjutan pada model bahasa besar (LLMs).

Baca Selengkapnya

Bagaimana AI mengalami “brain rot”?

Untuk pengujian, para peneliti memberi makan AI dengan aliran postingan yang terus-menerus dari X. Postingan-postingan tersebut dipilih berdasarkan viralitas, tingkat keterlibatan yang tinggi, serta postingan yang mengandung frasa yang mungkin bersifat clickbait, seperti “HARI INI SAJA,” dan “WOW.

”

Para peneliti menggunakan tolok ukur yang sudah ada seperti ARC dan RULER t o mengevaluasi hasilnya.

Hasilnya sungguh mengejutkan. Pada ARC, sebuah tolok ukur untuk kemampuan penalaran, terjadi penurunan skor total dari 74,9 menjadi 57,2.

Sementara pada RULER, sebuah tolok ukur pemahaman konteks panjang, skornya turun dari 84,4 menjadi 52,3.

Para peneliti menemukan bahwa LLMs mengalami ‘pembelokan pemikiran.’ Model tersebut hanya memberikan informasi yang tidak akurat tanpa mengikuti langkah-langkah yang tepat untuk memberikan hasil kepada pengguna.

Selain itu, model-model tersebut juga menjadi lebih jahat dan memperoleh sifat-sifat negatif. LLMs menunjukkan lonjakan dalam narsisme dan psikopati serta penurunan dalam keramahan dan kesadaran diri.

Fakta mengkhawatirkan lainnya adalah bahwa bahkan setelah peneliti memberikan data berkualitas tinggi, model-model tersebut tetap menunjukkan “efek sisa dari data sampah yang awalnya mereka terima.

” Ringkasan studi berjudul, LLMs Can Get “Brain Rot”!

Bagaimana cara menghentikan “brain rot” pada AI?

Ini tentu saja merupakan studi yang mengkhawatirkan.

Jangankan manusia, bahkan AI mungkin tidak dapat terbebas dari dampak buruk konten “brain rot”. Hal ini mungkin merugikan .dalam jangka panjang, mengingat internet hampir dibanjiri konten semacam itu setiap hari.

Para peneliti memang memiliki solusi. Studi tersebut menyatakan bahwa perusahaan harus mengevaluasi kembali cara AI mengambil data dari internet. Saat ini, model bahasa besar (LLM) hanya mengolah informasi yang tersedia secara daring.

Selain itu, ada kebutuhan yang semakin mendesak akan pengendalian kualitas dan pencegahan “dampak merugikan yang bersifat kumulatif” dalam jangka panjang.